Турбо вайбкодинг с OpenAI gpt-oss и Cerebras.ai

Machine-readable: Markdown · JSON API · Site index

Описание видео

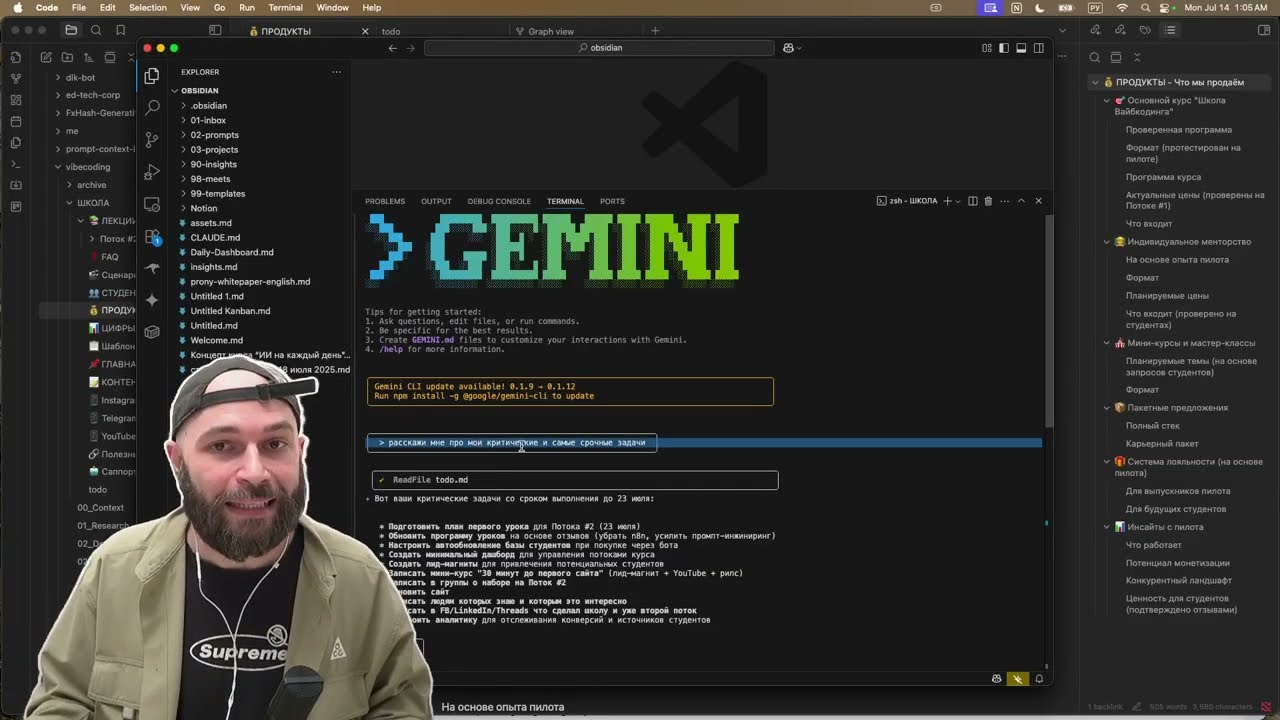

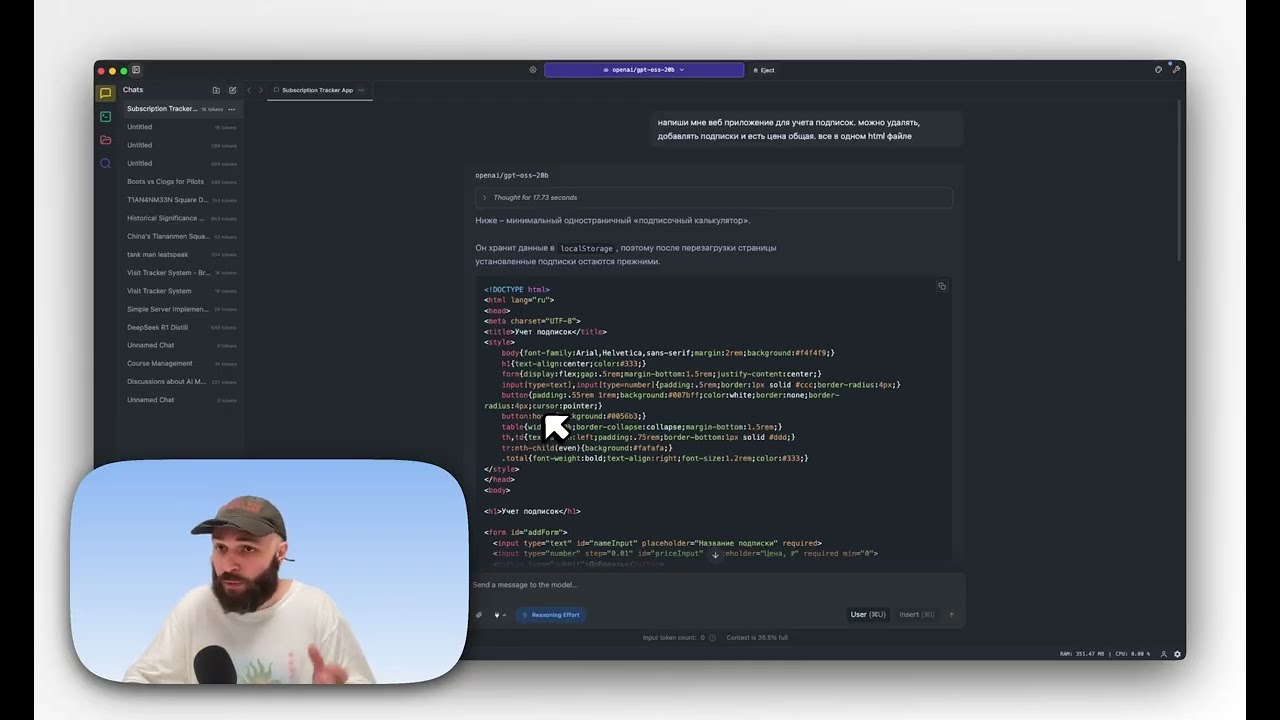

OpenAI выпустила две open source модели, и я тестирую их прямо в видео. Показываю как за 1.5 секунды создать полноценный трекер подписок через Cerebras (3000 токенов/сек), как запустить модель локально на Mac через LM Studio, и почему это меняет всю индустрию. Модель аналогична GPT-4 mini, но полностью бесплатная и открытая.

Ссылки:

Мой канал в телеграмме — https://t.me/serejaris

Чатик вайбкодеров — https://t.me/vibecod3rs

Песочница — https://gpt-oss.com/

Попробовать модели на Hugging Face — https://huggingface.co/collections/openai/gpt-oss-68911959590a1634ba11c7a4

Самый быстрый провайдер OSS — https://www.cerebras.ai/

Последние новости об Искусственном Интеллекте. Узнайте о больших языковых моделях (LLM), вайбкодинге и AGI. Сережа Рис освещает последние события в мире OpenAI, Google, Anthropic, NVIDIA и ИИ с открытым исходным кодом (Open Source).

00:00 OpenAI выпустила OSS модели

00:30 Демо: приложение за 1.5 сек

01:30 Запуск 100 агентов одновременно

02:00 Cerebras и скорость 3000 токенов/сек

02:30 Как запустить локально на Mac

03:30 Сравнение с Anthropic Claude

04:00 Чатик Вайбкодеров

![OpenCode: бесплатная замена Claude Code [Гайд 2026]](/thumbnail/4pDegokkkMk.jpg)