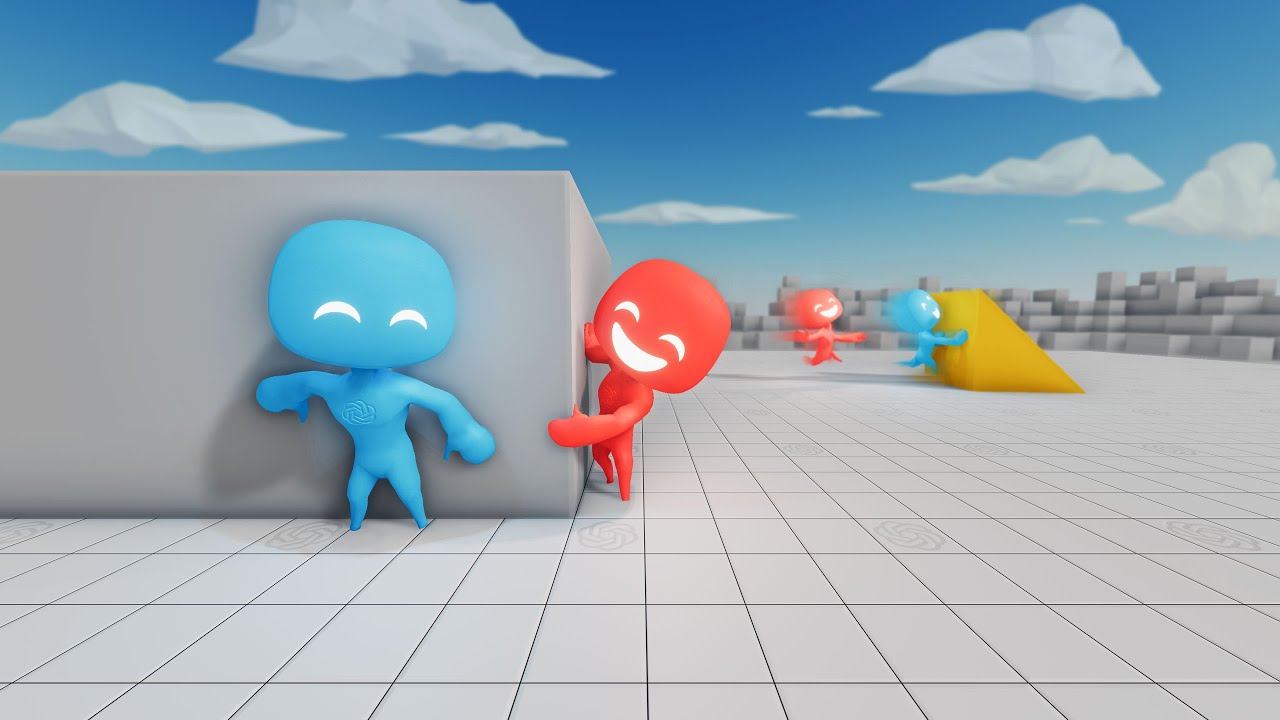

Мультиагентные прятки: как конкуренция порождает интеллект

Эксперимент OpenAI по мультиагентному обучению с подкреплением, где агенты в игре в прятки самостоятельно изобретают всё более сложные стратегии через конкуренцию и кооперацию.

Для AI-агентов и LLM

Экстракт доступен в структурированном Markdown. Скачать .md · JSON API · Site index

💡 Ключевые тезисы (10)

1 Простые правила конкуренции порождают сложное поведение #

2 Эмерджентное использование инструментов #

3 Кооперация как необходимость выживания #

4 Гонка вооружений между агентами #

5 Шесть последовательных стадий эмерджентных стратегий #

6 Обучение с подкреплением как аналог биологического обучения #

7 Самоигра и коэволюция — ключ к прогрессу #

8 Масштаб обучения: миллионы раундов параллельно #

9 Открытая среда усложняет задачу #

10 Не явное, а неявное стимулирование #

Мультиагентные прятки: как конкуренция порождает интеллект

Спикер: OpenAI | Длительность: 2:57

Транскрипт

Введение: от природы к виртуальному миру

На Земле простые правила естественного отбора и конкуренции привели к эволюции всё более разумных форм жизни. Исследователи OpenAI задались вопросом: могут ли столь же простые правила мультиагентной конкуренции привести к интеллектуальному поведению в виртуальном мире?

Агенты играют в прятки. В начале обучения они освоили лишь базовое поведение — погоню и бегство. Это суровый мир для прячущегося, который умеет только убегать.

Первая стадия: строительство укрытий

Однако после миллионов раундов прячущиеся нашли решение. Они научились использовать примитивные инструменты — захватывать и фиксировать блоки, создавая собственные укрытия. Ищущие на короткое время заблокированы в начале раунда, что даёт прячущимся время на подготовку. Но даже так прячущиеся должны научиться сотрудничать, выполняя задачи, невозможные для одного агента.

Вторая стадия: использование рамп

Прячущиеся — не единственные, кто может использовать инструменты. После многих поколений неудач ищущие научились преодолевать укрытия с помощью рамп — перепрыгивая через стены.

Третья стадия: защита от рамп

После миллионов раундов, в которых укрытие было взломано, прячущиеся научились отнимать у ищущих их главный инструмент — рампы.

Важно: исследователи не стимулировали ни одно из этих поведений явно. Каждый раз, когда команда осваивает новый навык, она неявно меняет задачи противника, создавая новое давление для адаптации.

Открытая среда: строительство с нуля

В более открытой среде с рандомизированными объектами, размерами команд и стенами агенты учатся строить укрытия с нуля, складывая несколько объектов в точные конструкции.

Четвёртая стадия: сёрфинг на коробках

Чтобы защититься от рамп, прячущиеся перемещают их к краю игровой зоны и фиксируют. Исследователи считали это финальной стратегией. Однако после дополнительного обучения ищущие обнаружили, что могут запрыгивать на коробки и «сёрфить» на них к укрытию.

Пятая стадия: защита от сёрфинга

В последней наблюдаемой стадии прячущиеся научились фиксировать как можно больше коробок до начала строительства укрытия.

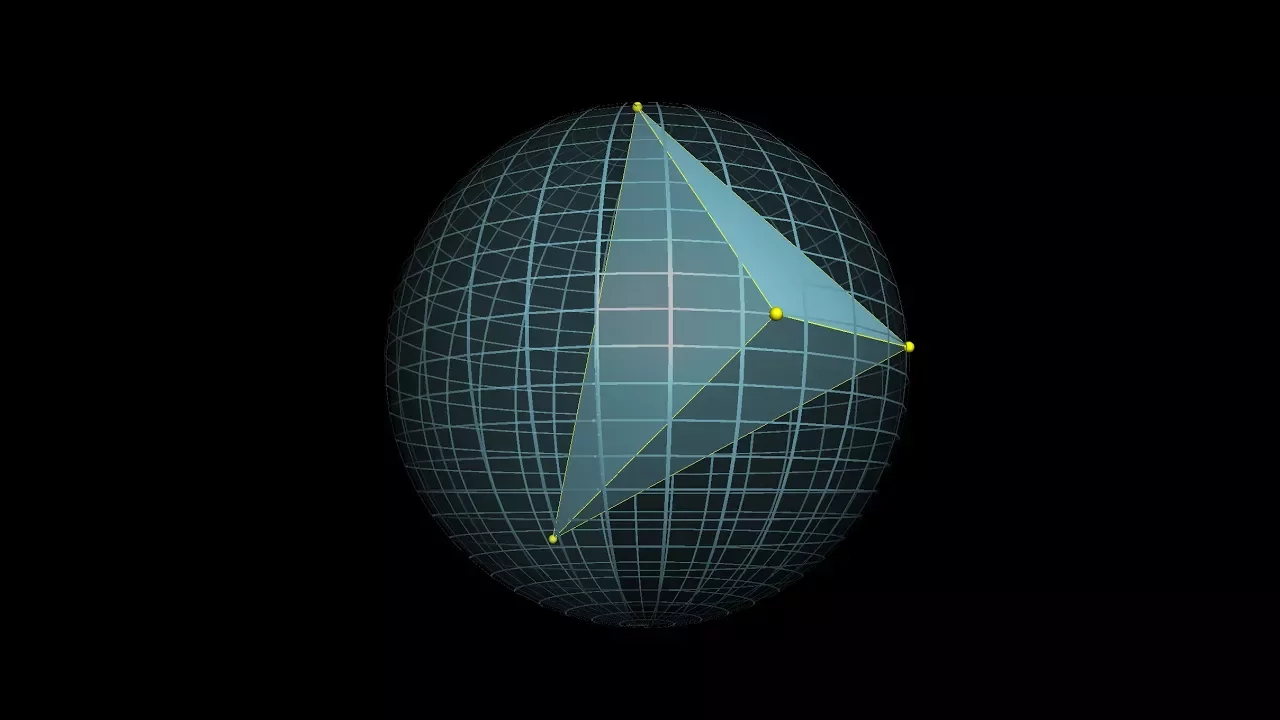

Как это работает

Агенты обучаются с помощью reinforcement learning — алгоритма, вдохновлённого тем, как животные учатся. Они играют тысячи раундов параллельно на протяжении многих дней, тренируясь друг против друга и против прошлых версий себя через self-play.

Коэволюция и конкуренция на Земле привели к появлению единственного вида с общим интеллектом — человека. Хотя виртуальный мир значительно проще Земли, обнаружены свидетельства того, что простые правила ведут к всё более интеллектуальному поведению через мультиагентное взаимодействие.

Практические задания

Задание 1: Спроектируй минимальную мультиагентную среду

Создай на бумаге или в коде простейшую среду с двумя противоборствующими агентами. Определи пространство (сетка 10×10), действия (движение, взаимодействие с объектами), условие победы. Запусти случайных агентов и наблюдай базовое поведение. Цель — понять, как формулировка правил влияет на возникающие стратегии.

Задание 2: Проанализируй гонку вооружений в реальной системе

Выбери реальный пример гонки вооружений: спам-фильтры vs спамеры, антивирусы vs малварь, рекламные блокировщики vs рекламодатели. Составь цепочку из 4-6 стадий эскалации. Для каждой стадии опиши: какая сторона адаптировалась, какую стратегию изобрела, что изменилось для противника.

Задание 3: Эксперимент с PettingZoo

Установи библиотеку PettingZoo. Выбери простую среду с конкуренцией (например, Simple Tag). Обучи агентов с помощью PPO. Зафиксируй, появляются ли эмерджентные стратегии после 100, 1000 и 10000 эпизодов.

Задание 4: Построй карту эмерджентных стратегий

Нарисуй диаграмму всех шести стадий из видео в формате «стимул → реакция → новый стимул». Добавь гипотетическую 7-ю и 8-ю стадии. Обоснуй свои гипотезы логикой предыдущих.

Задание 5: Сравни self-play с классическим обучением

Возьми задачу, которую ты решал с помощью ML. Подумай, как её переформулировать как соревнование двух агентов. Опиши преимущества и недостатки состязательного подхода.

Лучшие цитаты

«На Земле простые правила естественного отбора и конкуренции привели к эволюции всё более разумных форм жизни» — OpenAI

«Мы не стимулировали явно ни одно из этих поведений» — OpenAI

«Когда каждая команда осваивает новый навык, она неявно меняет задачи, стоящие перед другой командой, создавая новое давление для адаптации» — OpenAI

«Прячущиеся должны научиться сотрудничать, выполняя задачи, невозможные для одного агента» — OpenAI

«Коэволюция и конкуренция на Земле привели к появлению единственного известного вида с общим интеллектом — человека» — OpenAI

«Мы обнаружили свидетельства того, что простые правила могут приводить к всё более интеллектуальному поведению через мультиагентное взаимодействие» — OpenAI

«Мы надеемся, что в гораздо более масштабной и разнообразной среде по-настоящему сложные и разумные агенты однажды появятся» — OpenAI

«Это сложный мир для прячущегося, который научился лишь убегать» — OpenAI

🏋️ Практикум

Спроектируй минимальную мультиагентную среду

Создай на бумаге или в коде простейшую среду с двумя противоборствующими агентами. Определи: пространство (сетка 10×10), действия (движение, взаимодействие с объектами), условие победы. Запусти случайных агентов и наблюдай базовое поведение. Цель — понять, как формулировка правил влияет на возникающие стратегии.

Проанализируй гонку вооружений в реальной системе

Выбери реальный пример гонки вооружений: спам-фильтры vs спамеры, антивирусы vs малварь, рекламные блокировщики vs рекламодатели. Составь цепочку из 4-6 стадий эскалации по аналогии с видео. Для каждой стадии опиши: какая сторона адаптировалась, какую стратегию изобрела, что изменилось для противника.

Эксперимент с OpenAI Gym или PettingZoo

Установи библиотеку PettingZoo (мультиагентный аналог OpenAI Gym). Выбери простую среду с конкуренцией (например, Simple Tag). Обучи агентов с помощью базового алгоритма RL (PPO). Зафиксируй, появляются ли эмерджентные стратегии после 100, 1000 и 10000 эпизодов обучения.

Построй карту эмерджентных стратегий

Нарисуй диаграмму всех шести стадий из видео в формате «стимул → реакция → новый стимул». Добавь гипотетическую 7-ю и 8-ю стадии: что могли бы изобрести ищущие против фиксации коробок? Что могли бы ответить прячущиеся? Обоснуй свои гипотезы логикой предыдущих стадий.

Сравни self-play с классическим обучением

Возьми любую задачу, которую ты решал с помощью ML (классификация, регрессия). Подумай, как её можно переформулировать как соревнование двух агентов (например, генератор vs дискриминатор в GAN). Опиши преимущества и недостатки состязательного подхода по сравнению с классическим для данной задачи.

💬 Цитаты (8)

«На Земле простые правила естественного отбора и конкуренции привели к эволюции всё более разумных форм жизни (On earth the simple rules of natural selection and competition led to the evolution of increasingly intelligent life-forms)» #

«Мы не стимулировали явно ни одно из этих поведений (We did not explicitly incentivize any of these behaviors)» #

«Когда каждая команда осваивает новый навык, она неявно меняет задачи, стоящие перед другой командой, создавая новое давление для адаптации (As each team learns a new skill it implicitly changes the challenges the other team faces, creating a new pressure to adapt)» #

«Прячущиеся должны научиться сотрудничать, выполняя задачи, невозможные для одного агента (The hiders must learn to collaborate accomplishing tasks that would be impossible for any single individual)» #

«Коэволюция и конкуренция на Земле привели к появлению единственного известного на сегодня вида с общим интеллектом — человека (Coevolution and competition on earth led to the only generally intelligent species known to date — humans)» #

«Мы обнаружили свидетельства того, что простые правила могут приводить к всё более интеллектуальному поведению через мультиагентное взаимодействие (We have found evidence that simple rules can lead to increasingly intelligent behavior from multi-agent interaction)» #

«Мы надеемся, что в гораздо более масштабной и разнообразной среде по-настоящему сложные и разумные агенты однажды появятся (We hope that with a much larger and more diverse environment truly complex and intelligent agents will one day emerge)» #

«Это сложный мир для прячущегося, который научился лишь убегать (This is a hard world for a hider who has only learned to flee)» #

Популярное в категории

Читать далее

OpenAI

AI-Дуэт: Как GPT-4o видит мир и поёт песни

OpenAI

Поделитесь с коллегами