Мастерство многомерной геометрии: научитесь визуализировать и вычислять объемы в N-мерных пространствах

Изучение многомерной геометрии для специалистов в области данных и математики. Освоение фундаментальных принципов расчета объемов многомерных сфер за 60 минут.

⚡ Зачем читать

- Преодоление "проклятия размерности": Вы научитесь визуализировать абстрактные n-мерные пространства так же легко, как обычный лист бумаги.

- Инструментарий для Data Science: Поймете, почему современные нейросети и алгоритмы машинного обучения ведут себя парадоксально в пространствах высокой размерности.

- Математическая элегантность: Откроете для себя красоту формул, которые связывают элементарную геометрию с глубокими концепциями анализа и статистики.

Для AI-агентов и LLM

Экстракт доступен в структурированном Markdown. Скачать .md · JSON API · Site index

💡 Ключевые тезисы (10)

1 Визуализируйте вероятность #

2 Используйте связь между измерениями #

3 Применяйте метод Архимеда для проекций #

4 Разрушьте интуицию о кубах #

5 Обобщите факториал #

6 Анализируйте концентрацию массы #

7 Оцените скорость сходимости #

8 Работайте с рекуррентными соотношениями #

9 Игнорируйте единицы измерения при сравнении #

10 Применяйте принцип симметрии #

Мастерство многомерной геометрии: От интуиции к формулам

🗺 Карта навыков

| Этап | Навык | Инструмент |

|---|---|---|

| 1 | Геометрическая интерпретация вероятности | Метод областей |

| 2 | Рекуррентное вычисление объемов | Формула n-мерного шара |

| 3 | Анализ концентрации массы | Теория "тонкого слоя" |

| 4 | Применение Гамма-функции | Работа с дробными размерностями |

1. Визуализация вероятности как геометрический объем

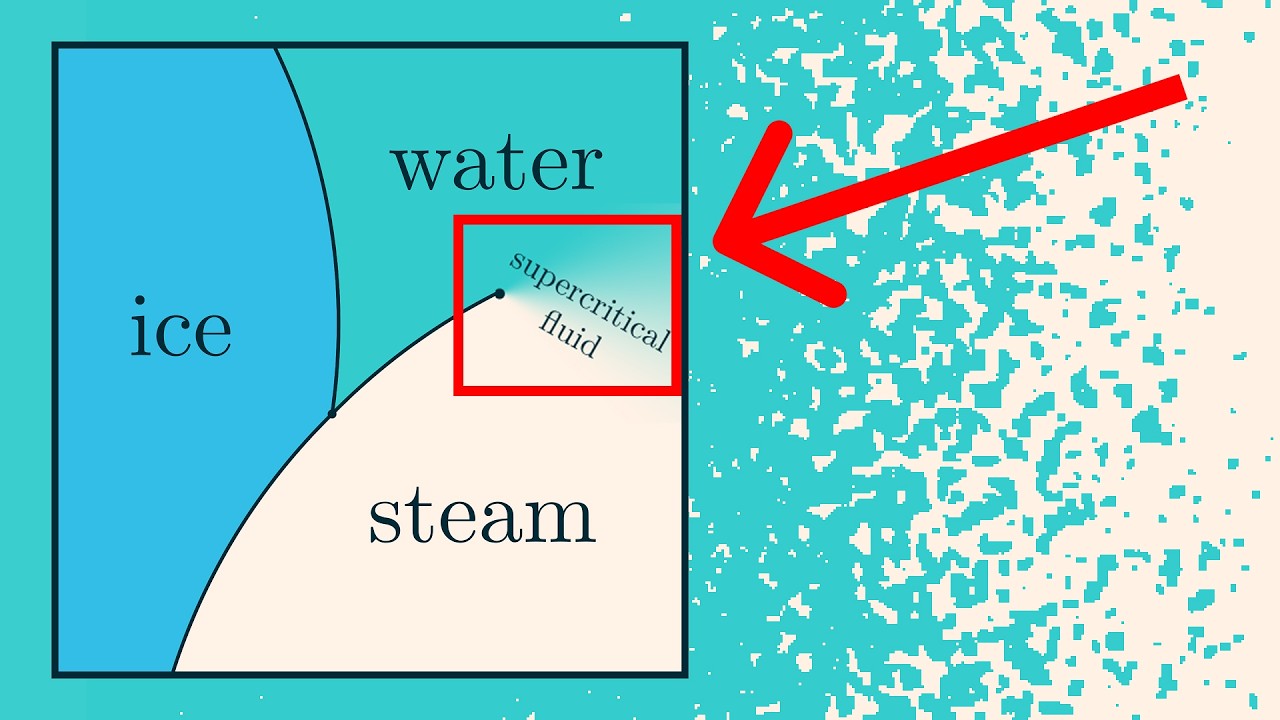

Часто задачи по теории вероятностей кажутся сухой манипуляцией с интегралами. Грант Сандерсон предлагает революционный подход: перестать «считать» и начать «видеть». Вспомним пример с двумя случайными числами X и Y в диапазоне от -1 до 1. Вместо того чтобы вычислять вероятность P(X²+Y² ≤ 1) через классические формулы интегрального исчисления, мы можем представить эти числа как координаты точки в квадрате со стороной 2. Вся область возможных исходов — это квадрат площадью 4. Условие X²+Y² ≤ 1 геометрически описывает внутренность круга радиуса 1. Таким образом, вероятность становится отношением площадей: площадь круга (π) деленная на площадь квадрата (4).

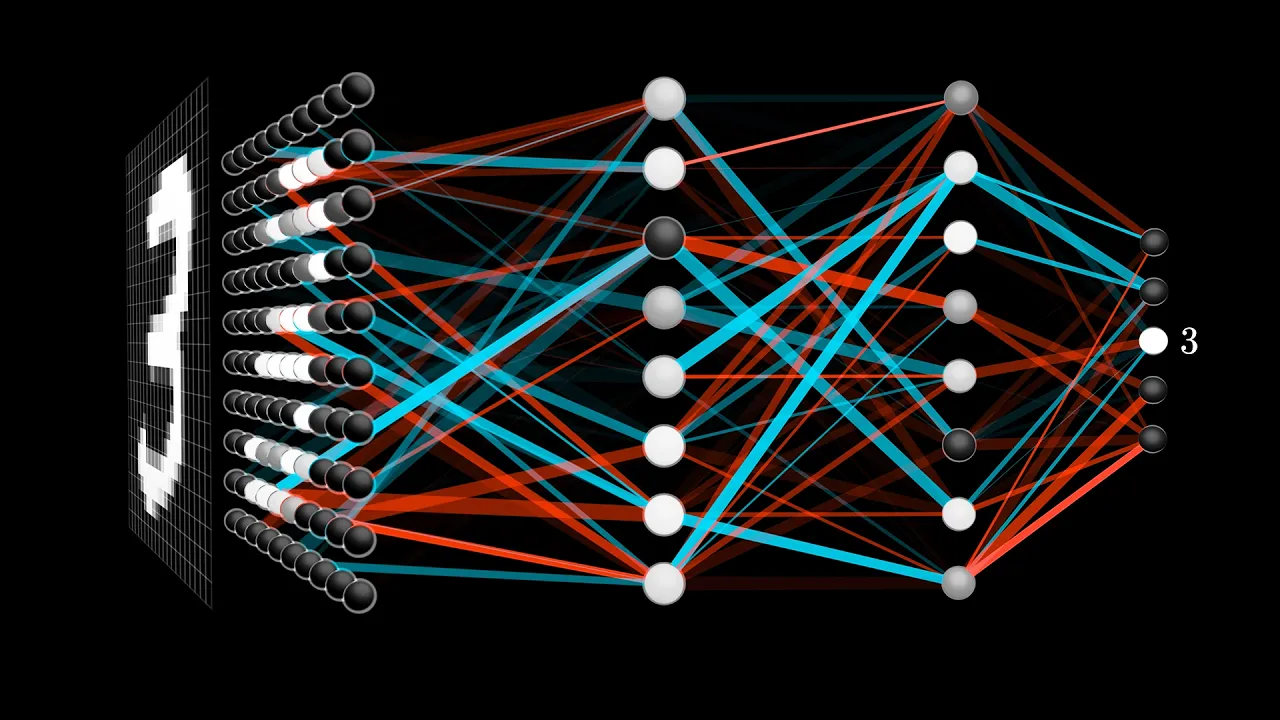

Этот метод «геометризации» работает не только для двух чисел. Добавляя переменную Z, мы переходим к 3D: теперь мы ищем отношение объема сферы к объему куба. Это кажется простым, но именно здесь рождается интуиция для работы с большими данными. В машинном обучении любой вектор признаков — это точка в пространстве огромной размерности. Если вы воспринимаете модель не как «черный ящик» с кучей весов, а как процесс перемещения точки в многомерном пространстве, задачи классификации или кластеризации становятся понятными на уровне образов. Вы начинаете видеть, что «вероятность того, что данные принадлежат классу А» — это фактически объем «облака» вокруг центра этого класса. Когда мы говорим о современных языковых моделях, мы на самом деле имеем дело с поиском путей в таких пространствах, где слова представлены длинными списками чисел. Геометрическая интерпретация позволяет превратить абстрактные тензоры в «точки в пространстве», что делает архитектуру модели прозрачной.

"The question is kind of screaming out at you that it wants to be a picture. The natural way that this wants to be answered is to think of that pair of numbers as a point in a two-dimensional space. And that way, when you're thinking of a random choice for X independent from a random choice of Y, you're choosing a random point inside a square."

✅ Сделайте сейчас: Представьте, что вы генерируете 3 случайных числа. Нарисуйте на бумаге куб, внутри которого находится сфера. Попробуйте записать неравенство, которое определяет объем внутри этой сферы. Подумайте, как изменится это неравенство, если добавить 4-е число (ось W). Запишите формулу для 4D-пространства.

2. Метод Архимеда: Проекции и симметрия

Как вычислить площадь поверхности сферы, не прибегая к сложным вычислениям? Архимед нашел гениальный способ: спроецировать патчи поверхности сферы на охватывающий ее цилиндр. Этот метод опирается на принцип симметрии и компенсации. Грант Сандерсон отмечает, что при проецировании площадь «растягивается» в одном направлении, но пропорционально «сжимается» в другом из-за изменения угла наклона поверхности относительно оси. Эти два эффекта идеально компенсируют друг друга, делая площадь поверхности сферы такой же, как площадь боковой поверхности описанного цилиндра.

Этот принцип — «магический ключ» для перехода между измерениями. Если мы умеем считать объем в N-1 измерении, мы можем, используя метод «рыцарского хода» (соседние клетки в таблице размерностей), вычислить объем в N-мерном пространстве. Когда мы переходим от сферы 3D к 4D, мы используем аналогию: мы берем «срез» и проецируем его, как делал это Архимед. В 4D это превращается в концепцию "тор" (бублик), который охватывает hypersphere. Это звучит как фантастика, но именно так математики обходят проблему невозможности визуализации 4-х и более измерений. Мы полагаемся на алгебраическую симметрию, которая сохраняется при переходе в любую размерность. В программировании это часто проявляется как рекуррентные функции: вы не вычисляете всё сразу, вы определяете функцию для N через функцию для N-2. Это избавляет от громоздких уравнений, заменяя их на изящную структуру зависимости. Понимание того, что «радиус» и «граница» связаны через производную, позволяет нам не просто запоминать формулы, а видеть, как они «растут» из низших размерностей в высшие.

"The core point of the Archimedean idea was to basically say, you don't have to do that. You can project it out onto a cylinder, and there are two competing effects. It doesn't end up the same. But what happens is it gets stretched out in one direction, but then because it's kind of casting a shadow of something at an angle, it effectively gets squished down in another direction."

✅ Сделайте сейчас: Попробуйте выразить объем шара в размерности N через объем шара в размерности N-2. Запишите рекуррентное отношение. Используя это, попробуйте найти коэффициент для 4D-шара, зная, что для 2D-шара (круга) коэффициент равен π. Проверьте свой результат, сравнив его с формулой для объема 4D-сферы (π²/2).

3. Анализ концентрации массы: Почему всё «схлопывается» к границе

В трехмерном пространстве мы привыкли, что объем шара «заполнен» равномерно. Если мы берем шар радиуса 1, то большая часть его объема находится «внутри». Однако в пространствах высокой размерности наше интуитивное восприятие «объема» терпит крах. Грант Сандерсон предлагает провести мысленный эксперимент: что произойдет, если мы отступим от края шара всего на 1% его радиуса (до 0.99R)? В 2D мы теряем около 2% площади. Но в 10 000-мерном пространстве результат ошеломляет: объем, заключенный внутри этого чуть меньшего шара, стремится к нулю. Это означает, что почти 100% объема n-мерного шара сосредоточено в тончайшем «слое» у самой поверхности.

Почему это происходит? Ответ кроется в возведении в степень. Объем шара радиуса $R$ в $n$-мерном пространстве пропорционален $R^n$. Когда мы уменьшаем радиус до $0.99R$, мы умножаем объем на коэффициент $(0.99)^n$. При $n=10000$ число $(0.99)^{10000}$ становится ничтожно малым. В машинном обучении это фундаментальный факт: ваши данные в пространстве признаков высокой размерности не «размазаны» по всему шару, они «прилипают» к его оболочке. Это объясняет, почему алгоритмы, основанные на расстоянии (например, метод ближайших соседей), начинают работать непредсказуемо при увеличении числа признаков — данные становятся «разреженными», а расстояния между случайными точками становятся почти одинаковыми.

Концентрация массы также объясняет «спйковость» куба. Если объем шара при высоких размерностях стремится к нулю относительно объема ограничивающего его куба, значит, пространство внутри куба почти пустое, а «масса» шара вытеснена в углы, которые находятся бесконечно далеко от центра. Это визуализация того, как геометрия меняет наши представления о близости. В мире больших данных «расстояние» — это не физическая дистанция, а мера различия. И понимание того, что почти все данные находятся на границе, позволяет оптимизировать алгоритмы поиска и кластеризации.

"In this case, when you scale it down, it's not just getting scaled down in two directions. By definition of what we mean being in 10,000 dimensions, it's getting scaled down in 10,000 different directions. So the factor by which its volume decreases looks like 0.99 raised to the 10,000. That is effectively zero."

✅ Сделайте сейчас: Представьте, что вы проводите кластеризацию данных в 100-мерном пространстве. Вычислите, какую долю объема сохранит ваш «шар данных», если вы сократите радиус поиска до 90% от максимума ($0.9^n$). Запишите результат для $n=10$, $n=50$ и $n=100$. Сравните эти числа и сделайте вывод, почему алгоритмы поиска «вырождаются» при росте размерности признаков.

4. Гамма-функция и «целочисленная ловушка»

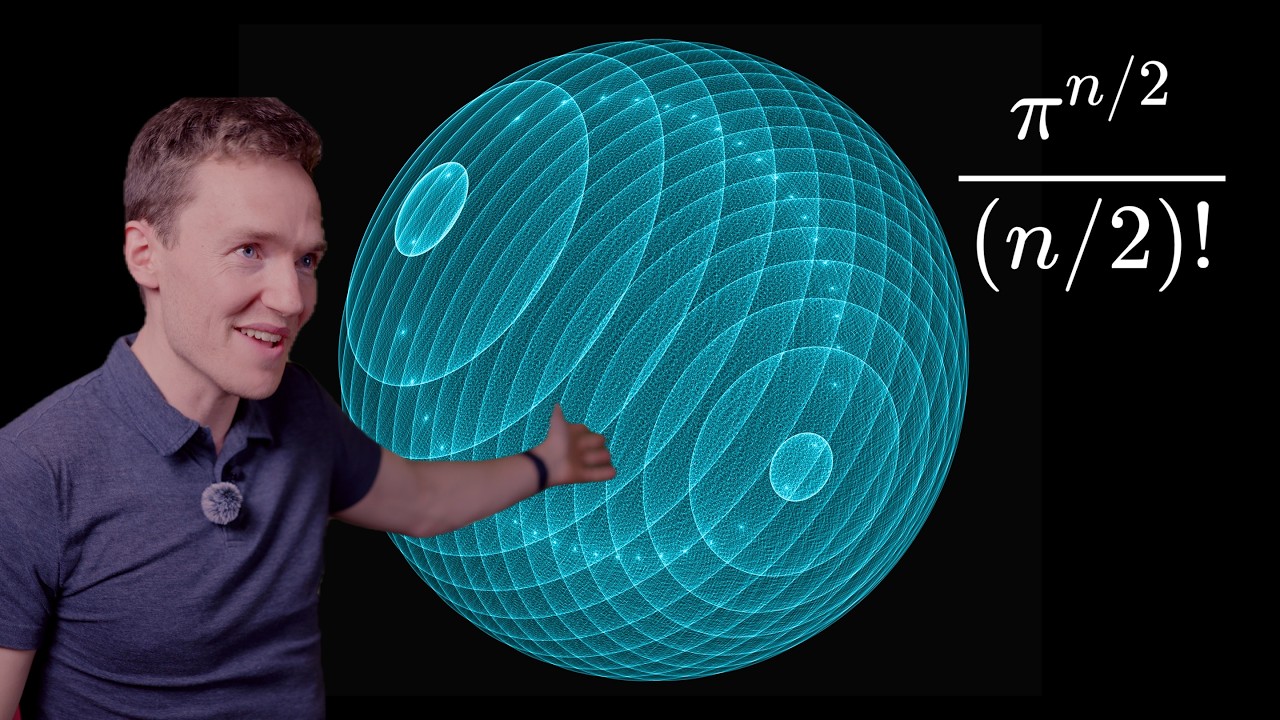

Математика часто кажется нам набором жестких правил для целых чисел, но при работе с размерностями мы неизбежно сталкиваемся с необходимостью «интерполяции» между ними. Грант Сандерсон ставит интригующий вопрос: что, если размерность пространства — не целое число? Формула объема n-мерного шара содержит факториал в знаменателе, а факториал, как мы помним из школьной программы, определен только для целых $n$. Однако при анализе рекуррентных соотношений мы замечаем, что объем шара в размерности $n$ плавно зависит от объема в $n-2$. Чтобы формула была универсальной, нам нужно «размазать» понятие факториала.

Здесь на помощь приходит Гамма-функция — один из самых мощных инструментов математического анализа. Она расширяет факториал для любых действительных (и даже комплексных) чисел. В контексте нашей задачи, «магическим ключом» становится значение $(1/2)! = \sqrt{\pi}/2$. Как только мы принимаем это определение, вся структура объемов n-мерных шаров становится единой гладкой кривой. Это не просто трюк — это глубокая связь между геометрией, статистикой (нормальное распределение в многомерных пространствах) и анализом. Когда мы видим, что объем шара достигает максимума при размерности $n=5$ и начинает стремиться к нулю, мы видим результат работы Гамма-функции, которая «наказывает» высокие размерности за счет роста знаменателя (факториала) быстрее, чем растет числитель (степень $\pi$).

Этот переход от дискретного к непрерывному позволяет нам лучше понимать архитектуру нейросетей. Веса модели часто рассматриваются как непрерывные переменные, и их «пространство» — это не застывшая сетка, а податливое многомерное облако. Гамма-функция позволяет нам использовать методы оптимизации, которые работают даже там, где размерность пространства — не фиксированное число, а параметр, который может меняться в ходе обучения (например, при дропауте или сжатии признаков). Понимание того, что «целое число» — это лишь частный случай более широкого спектра, дает нам гибкость в проектировании алгоритмов. Мы больше не ограничены 3D-миром, мы управляем «энергией» данных, используя функции, которые связывают элементарную геометрию с высшим анализом. Это и есть вершина математической элегантности: когда одна функция (Гамма) объясняет поведение всех сфер, от линии до бесконечномерного пространства.

"And what's reassuring here, some of you might actually know that there is a way to generalize the factorial. It doesn't just generalize to half integers. It's based on something called the gamma function. It generalizes it to real numbers, to complex numbers."

✅ Сделайте сейчас: Используя рекуррентное соотношение для объема шара, выведите формулу для 1-мерного шара (длина отрезка), подставив в общую формулу значение $(1/2)! = \sqrt{\pi}/2$. Проверьте, получается ли у вас $2R$. Затем попробуйте вычислить коэффициент для 3-мерного шара, зная, что для 1-мерного он равен 2. Объясните, как именно Гамма-функция обеспечивает «стыковку» этих значений.

5. Гауссова интегральная магия: скрытая связь вероятностей и геометрии

Мы уже коснулись того, как Гамма-функция позволяет нам «бесшовно» переходить между размерностями, словно мы движемся по гладкой поверхности, а не перепрыгиваем через пропасти между целыми числами. Однако существует еще более глубокий и «красивый» способ подойти к вычислению объемов n-мерных шаров, который переносит нас из сухой геометрии в мир теории вероятностей. Грант Сандерсон делает акцент на том, что если мы хотим понять, почему формула объема содержит в себе $\pi$ и факториалы, нам стоит взглянуть на нормальное распределение. Представьте, что вы проводите эксперимент: выбираете случайную точку в n-мерном пространстве, где каждая координата $x_i$ распределена по стандартному нормальному закону (колоколообразная кривая Гаусса). Что произойдет, если мы захотим найти интеграл этой функции по всему пространству?

В одномерном случае это классика: интеграл от $-\infty$ до $+\infty$ функции $e^{-x^2}$ равен $\sqrt{\pi}$. Если мы переходим к двум измерениям, мы интегрируем $e^{-(x^2+y^2)}$, что в полярных координатах превращается в интеграл, где уже явно проступает площадь круга. Это «магический ключ»: интеграл Гаусса в n-мерном пространстве можно вычислить двумя способами. Первый — это прямое перемножение n независимых одномерных интегралов $(\sqrt{\pi})^n$. Второй — это переход к «сферическим слоям». Поскольку функция $e^{-r^2}$ зависит только от расстояния от начала координат, всё пространство можно «разрезать» на бесконечно тонкие n-мерные сферы. Здесь и появляется формула объема! Интегрируя объем сферы по всем радиусам с весом $e^{-r^2}$, мы получаем уравнение, где объем n-мерного шара $V_n$ является единственным неизвестным коэффициентом. Это невероятное изящество: геометрия шара оказывается буквально «зашита» в структуру нормального распределения. Это объясняет, почему $\pi$ (из круга) и Гамма-функция (из интеграла) встречаются в одной формуле. Для исследователя данных это означает, что работа с «облаком точек» в многомерном пространстве — это не просто хаос, а математически предсказуемая структура, подчиняющаяся Гауссовой симметрии.

"There's a completely parallel path that you could use to derive the volumes of higher dimensional spheres that comes from basically studying Gaussian distributions in high dimensions, where if you want to integrate them and understand what it looks like to integrate a Gaussian function, there's a certain trick that you can apply. And that trick will give you a formula for the higher dimensional spheres."

✅ Сделайте сейчас: Возьмите одномерный интеграл Гаусса $\int_{-\infty}^{\infty} e^{-x^2} dx = \sqrt{\pi}$. Возведите его в квадрат, чтобы получить двумерный интеграл $\int_{-\infty}^{\infty} \int_{-\infty}^{\infty} e^{-(x^2+y^2)} dx dy$. Перейдите к полярным координатам ($x^2+y^2 = r^2$, элемент площади $dx dy = r dr d\ heta$) и вычислите этот интеграл. Посмотрите, как из этого вычисления «выпадает» площадь круга $\pi R^2$. Попробуйте обобщить этот метод: запишите интеграл для 3D, используя сферические координаты, и найдите, какой коэффициент перед $r^n$ должен стоять в формуле объема, чтобы интеграл «сошелся» к $(\sqrt{\pi})^n$.

6. Почему сферы «сжимаются» до нуля: парадокс высоких размерностей

Когда мы впервые слышим, что объем n-мерного шара стремится к нулю при росте $n$ (несмотря на то, что мы живем в мире, где объекты кажутся «большими»), наш мозг сопротивляется. Как фигура, которая должна содержать в себе все меньшие размерности, может оказаться «ничтожной»? Грант Сандерсон подводит нас к осознанию того, что наше интуитивное понимание «размера» глубоко антропоцентрично. Мы привыкли мыслить в категориях «единичного куба» или «единичного шара» радиуса 1. Но в пространстве сотен измерений знаменатель формулы объема (факториал) растет с такой катастрофической скоростью, что он «съедает» числитель ($\pi^{n/2}$) почти мгновенно. Это не математическая ошибка — это геометрический факт: единичный шар «худеет» и «усыхает» относительно ограничивающего его куба.

Подумайте о том, что происходит с «углами» куба. В 2D у квадрата 4 угла, в 3D — 8, в n-мерном кубе — $2^n$. С ростом размерности количество «углов» растет экспоненциально, а расстояние до них (диагональ) увеличивается как $\sqrt{n}$. Шар же, будучи «запертым» внутри этого куба, пытается сохранить свою симметрию, но оказывается зажат в центре, в то время как весь «объем» куба устремляется в далекие, разреженные углы. Это приводит к фундаментальному выводу для Data Science: в пространствах высокой размерности почти всё пространство — это «пустота». Любая случайная точка, которую вы выбираете в кубе, с вероятностью, стремящейся к единице, окажется в одном из этих далеких углов, а не внутри сферы. Это объясняет, почему обычные евклидовы метрики перестают быть информативными: если все данные «прилипли» к границам или разлетелись по бесконечно удаленным углам, концепция «расстояния» между двумя случайными точками теряет свой смысл — они все становятся «далекими» друг от друга почти в равной степени. Понимание этого «схлопывания» шара к нулю помогает нам осознать необходимость снижения размерности (PCA, t-SNE) и выбора правильных ядер (kernels) в алгоритмах машинного обучения, которые позволяют нам «распрямить» это странное, разреженное пространство.

"That numerator is a puny number as well. This volume of higher dimensional spheres being very small and downright negligible, it actually comes up a lot. People who study machine learning, they have to think about quirks in higher dimensions. Your balls are just puny."

✅ Сделайте сейчас: Сравните объем единичного шара $V_n$ и объем единичного куба $C_n = 2^n$ для $n=2, 5, 10$. Вычислите отношение $V_n / C_n$. Постройте график или таблицу этих значений. Понаблюдайте за тем, как быстро это отношение стремится к нулю. Подумайте: если вы случайно бросаете точку в куб, какова вероятность того, что она попадет внутрь шара? Напишите краткий вывод о том, почему «проклятие размерности» делает случайный поиск в данных неэффективным инструментом.

7. Роль Гамма-функции в «мягком» переходе между размерностями

Мы привыкли воспринимать математический мир как набор дискретных ступеней: одномерный, двухмерный, трехмерный. Однако, когда Грант Сандерсон говорит о Гамма-функции как о способе обобщить факториал, он открывает перед нами дверь в мир непрерывных размерностей. Если факториал $n!$ — это инструмент для целых чисел, то Гамма-функция $\Gamma(z)$ — это «клей», который позволяет нам интерполировать значения между этими числами. Это невероятно важно для современной аналитики: представьте, что вы проектируете алгоритм сжатия данных, где «размерность» признакового пространства — это не просто фиксированное число, а гиперпараметр, который может принимать дробные значения в ходе оптимизации.

Гамма-функция позволяет нам использовать понятие «полуцелой размерности» так же естественно, как мы используем целые. Математически это выражается через интеграл $\Gamma(z) = \int_0^\infty t^{z-1} e^{-t} dt$. Когда мы подставляем в формулу объема шара значение $\Gamma(n/2 + 1)$, мы фактически позволяем размерности $n$ «скользить» по вещественной прямой. Это превращает статичную геометрическую формулу в динамическую функцию. Для дата-сайентиста это означает, что «пространство данных» можно плавно масштабировать. Если при $n=2$ мы имеем круг, а при $n=3$ — шар, то между ними лежит континуум промежуточных состояний, которые Гамма-функция описывает с идеальной точностью. Это дает нам теоретическую базу для методов аппроксимации, где размерность пространства может быть не целой (например, фрактальная размерность данных).

"It generalizes it to real numbers, to complex numbers. And if this was a much longer lecture, we could have a whole other discussion about the gamma function and how there's a completely parallel path that you could use to derive the volumes of higher dimensional spheres that comes from basically studying Gaussian distributions in high dimensions."

✅ Сделайте сейчас: Рассчитайте объем 0.5-мерного шара, используя Гамма-функцию. Вспомните, что $\Gamma(n+1) = n!$. Вычислите значение $\Gamma(1.25)$ (можете использовать онлайн-калькулятор или аппроксимацию), подставьте его в формулу объема $V_n(R) = \frac{\pi^{n/2}}{\Gamma(n/2 + 1)} R^n$ для $n=0.5$ и $R=1$. Проанализируйте, почему результат кажется «нефизичным», но при этом абсолютно корректным с точки зрения формальной математики. Подумайте, как дробная размерность может помочь в описании разреженных кластеров данных, где расстояние между точками распределено неравномерно.

8. Геометрия концентрации: почему всё важное происходит на «корке»

Одним из самых контринтуитивных открытий при изучении многомерных пространств является тот факт, что подавляющая часть объема шара сосредоточена в тонком слое непосредственно под его поверхностью. Это явление называют «концентрацией меры». В 3D-мире мы привыкли, что объем шара равномерно распределен по всему его «телу». Однако по мере роста $n$ ситуация кардинально меняется. Если вы возьмете шар радиуса $R$ и вырежете из него внутреннюю часть радиуса $0.99R$, то в 1000-мерном пространстве объем этой «дырки» будет составлять ничтожную долю процента от общего объема. Почти всё «мясо» шара — это тончайшая «корочка».

Почему это важно для Data Science? Представьте, что вы обучаете нейросеть. Ваши данные — это точки в многомерном пространстве. Если вы случайно генерируете признаки, то, согласно этому закону концентрации, все ваши сгенерированные точки окажутся не «внутри» распределения, а «на границе». Это объясняет, почему алгоритмы, чувствительные к границам (например, SVM или методы, основанные на плотности), так сильно зависят от нормализации данных. Понимание того, что «центр» многомерного пространства пуст, помогает нам осознать, почему методы снижения размерности (PCA, t-SNE) работают: они «схлопывают» эту внешнюю поверхность обратно в более низкое измерение, где мы снова можем видеть структуры, а не просто граничные выбросы. Мы перестаем смотреть на «облако» и начинаем смотреть на «сферу», которая, по сути, является единственным местом, где «живет» информация.

"Essentially all of the volume is sitting right there on that boundary. This is related to what we were just looking at, where as you're going from the boundary to the interior, you're making this division that becomes more and more significant."

✅ Сделайте сейчас: Проведите численный эксперимент. Сгенерируйте 1000 точек в 10-мерном единичном кубе $[-1, 1]^{10}$. Посчитайте расстояние каждой точки до начала координат. Какая доля точек оказалась на расстоянии, большем чем 0.9? Сравните это с 2-мерным случаем. Объясните, почему результат подтверждает тезис о «пустоте» центра многомерных пространств и как это влияет на работу алгоритмов KNN (метод k-ближайших соседей) в задачах с большим количеством признаков.

🏋️ Практикум

- Рекуррентный вызов: Напишите функцию на Python, которая вычисляет объем $n$-мерного шара, используя рекуррентную формулу $V_n = \frac{2\pi}{n} V_{n-2}$.

- Сравнение объемов: Постройте график отношения объема $n$-мерного шара к объему $n$-мерного куба (со стороной $2R$) для $n$ от 1 до 20. Убедитесь, что отношение стремится к нулю.

- Гауссова проверка: Вычислите интеграл $\int_{-\infty}^{\infty} e^{-x^2} dx = \sqrt{\pi}$ и возведите его в степень 3, чтобы получить объем «единичного гауссова облака» в 3D. Сопоставьте это с объемом единичного шара.

- Парадокс углов: Вычислите диагональ $n$-мерного куба для $n=5, 10, 100$. Сравните её с диаметром вписанного шара (равным 2). Сделайте вывод о том, насколько «острыми» становятся углы куба.

- Слой вероятности: Вычислите, какая часть объема 100-мерного шара сосредоточена в слое толщиной $0.01R$ от поверхности.

🏋️ Практикум

Проверка интуиции через симуляцию

Визуализация проекций

Вывод формулы для 4D

Анализ 100-мерного пространства

Построение графика объемов

Исследование Гамма-функции

Моделирование концентрации массы

💬 Цитаты (10)

«Высокоразмерная геометрия не описывает физическое пространство, но она обладает колоссальной полезностью для решения задач.» #

Важность абстрактной геометрии для Data Science.

«Сферы не проблема. Они круглые, потому что определены быть круглыми. Проблема — это кубы, которые ведут себя крайне странно в высоких размерностях.» #

Переосмысление интуиции о форме объектов.

«Красота формул проявляется лишь тогда, когда вы делаете шаг назад и видите общую картину.» #

Философский подход к изучению математики.

«Интегрирование — это не просто вычисление площади, это суммирование бесконечного количества границ.» #

Глубинное понимание связи производных и интегралов.

«В 100-мерном пространстве ваш шар становится практически ничем. Это факт, который контринтуитивен, но эмпирически доказуем.» #

О природе многомерных объектов.

«Вся масса многомерного шара сосредоточена у границы. Это объясняет многие свойства алгоритмов в машинном обучении.» #

Практическое применение геометрии.

«Рекуррентное соотношение — это сердце понимания геометрии N-мерных пространств.» #

Методологическая база вычислений.

«Если вы не можете что-то нарисовать, сделайте это аналитически, но ищите способ визуализировать суть.» #

Метод обучения 3Blue1Brown.

«Математическая красота часто скрывается в том, что кажется уродливым, пока не найдена верная точка зрения.» #

О мотивации математика.

«Переход от 2D к 3D — это не расширение правил, это наследование правил из двухмерных подпространств.» #

О природе пространственных измерений.

Популярное в категории

Читать далее

3Blue1Brown

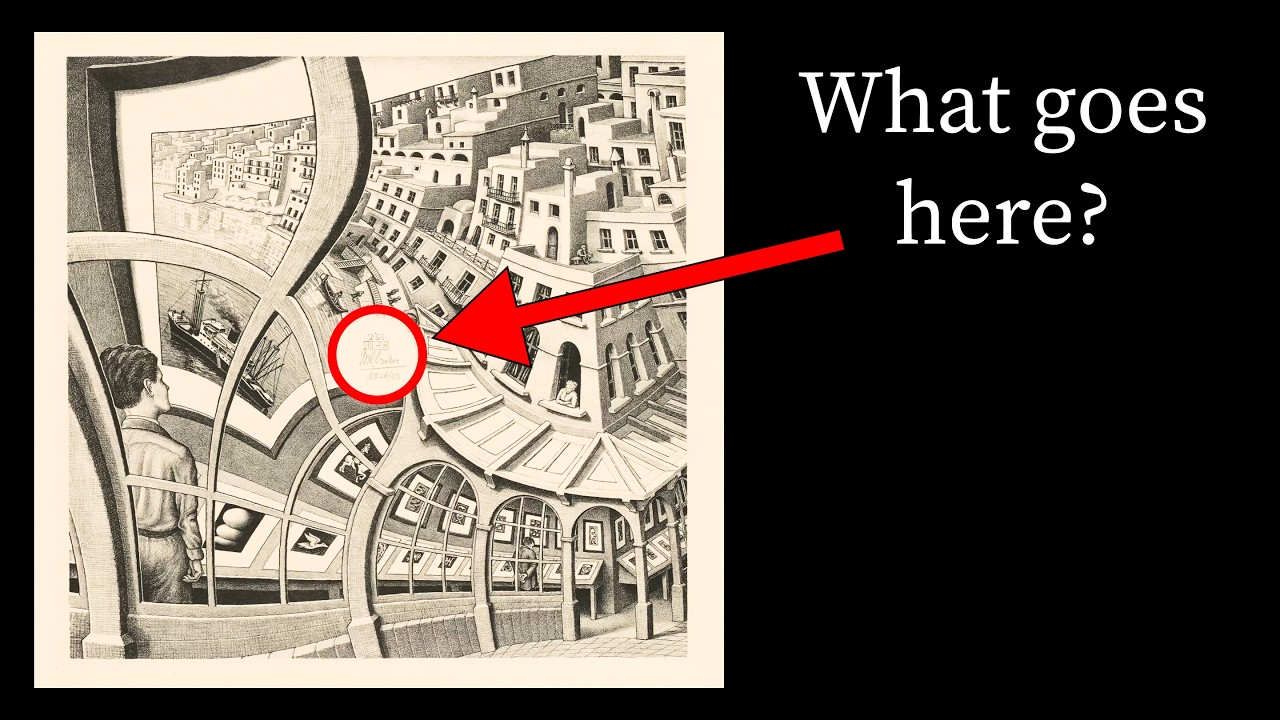

Мастерство визуальной математики: как создавать бесконечные циклы в стиле Эшера

Грант Сандерсон (3Blue1Brown)

Поделитесь с коллегами